Nieuw systeem laat robot knuffelbeer bij zijn oor oppakken

Een nieuw systeem stelt robots in staat objecten veel beter te begrijpen, waardoor zij objecten nauwkeuriger kunnen manipuleren. Zo kunnen robots met het systeem een object bij een specifiek deel oppakken, zoals een knuffelbeer bij zijn oor of een schoen aan de lip.

Al langer werken onderzoekers aan software die robots in staat stelt onbekende objecten succesvol op te pakken. Zo ontwikkelde het MIT in samenwerking met de Princeton University eerder een systeem dat uit een bak vol met willekeurige objecten een specifiek object kan oppakken, zonder dit object eerder gezien te hebben. De robot analyseert vervolgens dit object, vergelijkt het object met objecten die het eerder heeft gezien en bepaalt op basis hiervan in welke bak het object neergelegd dient te worden.

Dense Object Nets

Het nieuwe systeem Dense Object Nets (DON) van MIT’s Computer Science and Artificial Intelligence Laboratory (CSAIL) gaat echter een stuk verder. Dit systeem stelt robots in staat veel specifiekere opdrachten uit te voeren. Denk hierbij aan ’til de rode knuffelbeer op aan zijn linkerarm’ of ’til de speelgoedauto op aan het rode deel’.

“Veel manipulatiemethodes zijn niet in staat specifieke delen van een object te identificeren in de vele verschillende oriëntaties die een object kan hebben”, zegt afstudeerstudent Lucas Manuelli van CSAIL. Manuelli heeft samen met hoogleraar Russ Tedrake en afstudeerstudent Pete Florence een paper geschreven over DON. “Bestaande algoritmes zouden bijvoorbeeld niet in staat zijn een kop bij zijn oor op te pakken, zeker als deze kop verschillende oriëntaties kan hebben zoals staand of op zijn zijkant.”

Visuele kaart

Dit is mogelijk doordat DON een object omzet in een collectie van punten, die functioneren als een visuele kaart. Aan de hand van deze punten kan het systeem een 3D-model van het object maken. Indien een persoon vervolgens een bepaald deel van het object specificeert, kan de robot aan de hand van dit model dit deel identificeren en het object hier oppakken.

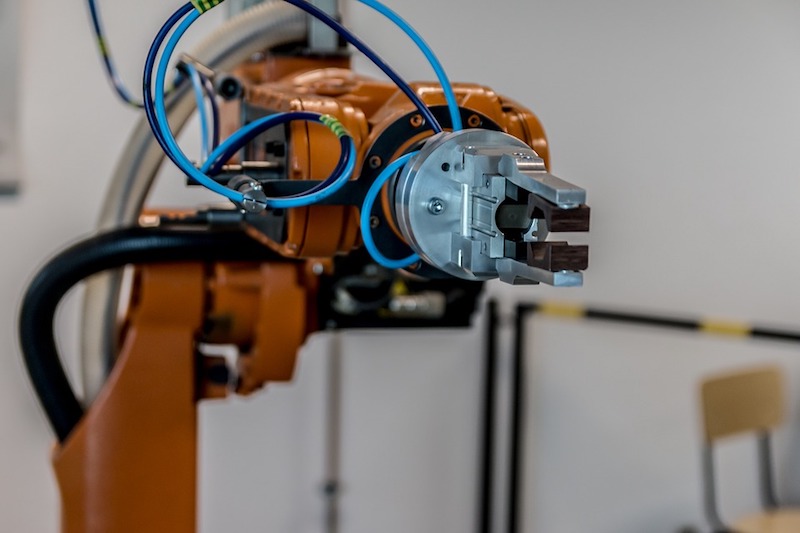

De onderzoekers hebben verschillende experimenten uitgevoerd met een KUKA robotarm voorzien van DON waarin deze robot verschillende opdrachten moest uitvoeren. Zo wist de robotsarm tijdens één van de experimenten een speelgoedrups met succes bij zijn oor op te pakken. Tijdens een ander experiment slaagde de robot erin een specifieke pet uit een bak vol petten te pakken, zonder deze pet ooit gezien te hebben – ook niet in trainingsdata.

Toepassingen

De onderzoekers zien in verschillende omgevingen mogelijke toepassingen voor DON, onder andere in de industrie. “In fabrieken hebben robots vaak complexe ‘part feeders’ nodig om betrouwbaar te werken”, legt Florence uit. “Een systeem als deze dat de oriëntatie van objecten begrijpt kan simpelweg een foto nemen en vervolgens in staat zijn een object op te pakken en te manipuleren.”

Het onderzoeksteam wijst op de nieuwswebsite van MIT daarnaast ook op commerciële robots voor thuisgebruik. Zo zouden gebruikers een robot met behulp van DON hun huis kunnen laten schoonmaken door simpelweg een foto van hun woning in opgeruimde staat te tonen.

De paper van Manuelli en Florence getiteld ‘Dense Object Nets: Learning Dense Visual Object Descriptors By and For Robotic Manipulation’ is hier te vinden.

Auteur: Wouter Hoeffnagel

Bron: MIT

Bron foto: Pixabay / jarmoluk

Meer nieuws

Robot van Deense O-Robotics ruimt straten op

(productnews)

Algemeen / 18-12-2024

Lees meerGrootste fractie Europarlement wil streep voor verbod op verbrandingsmotor

(productnews)

Automotive / 16-12-2024

Lees meerNieuw multifunctioneel zonneraam wekt stroom op door licht te weerkaatsen

(productnews)

Bouw & Constructie / 16-12-2024

Lees meerPBL: ‘Nederland op koers om streefdoel van 35 TWh aan wind- en zonneparken in 2030 te halen’