Nieuw systeem maakt aansturing van robots met spiersignalen mogelijk

Een nieuwe technologie maakt het mogelijk robots met behulp van spiersignalen aan te sturen. Het systeem moet hiermee de aansturing van robots vereenvoudigen en de samenwerking tussen mensen en robots versterken.

Het systeem heet Conduct-a-Bot en is ontwikkeld door Joseph DelPreto en Daniela Rus van MIT’s Computer Science and Artificial Intelligence Laboratory (CSAIL). Interactie hebben met robots is niet nieuw. Veel bestaande methodes om robots aan te sturen zijn volgens de onderzoekers echter onhandig. Als voorbeeld noemen zij aansturing behulp van specifieke spraakcommando’s of het gebruik van touchscreens.

Spier- en bewegingssensoren

Conduct-a-Bot maakt gebruik van spier- en bewegingssensoren om de bewegingen van mensen te monitoren. Dit maakt het mogelijk robots aan te sturen met behulp van spiersignalen en bewegingen. Het systeem werkt met behulp van kleine sensoren die op de biceps, triceps en onderarm worden geplaatst.

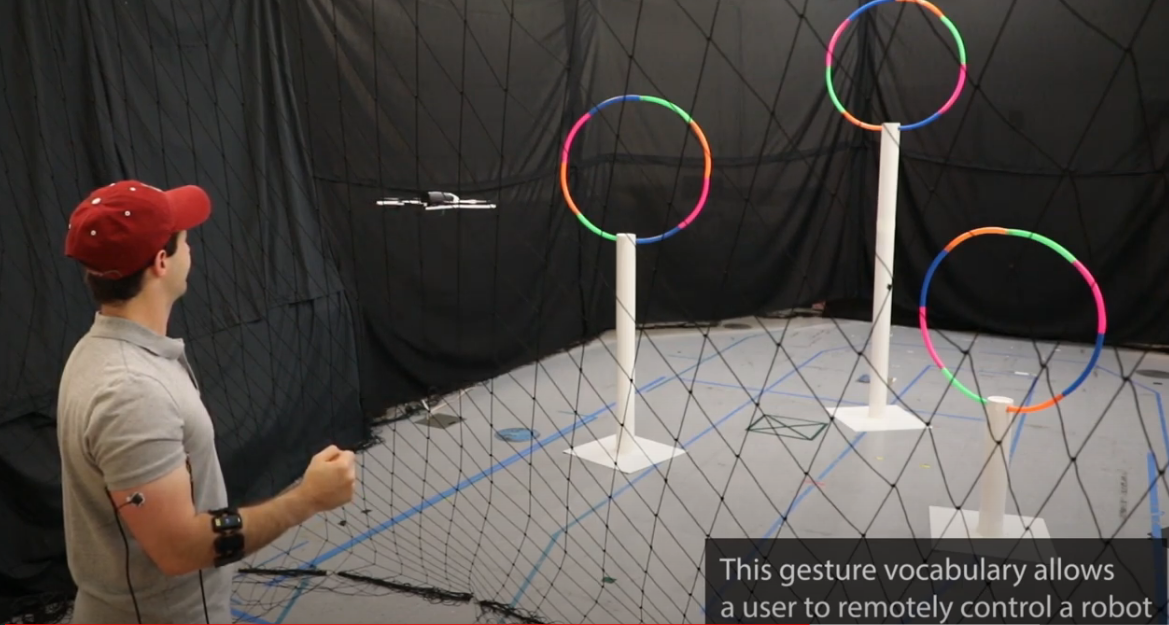

Het systeem is nog in ontwikkeling. De huidige variant is in staat acht voorgeprogrammeerde bewegingen te herkennen. Het systeem trainen of offline kalibreren is niet nodig; zodra een nieuwe gebruiker de sensoren op zijn of haar biceps, triceps en onderarm plaatst is het systeem direct bruikbaar. De huidige opstelling van Conduct-a-Bot is getest in combinatie met een Parrot Bebop 2 drone.

Deze voorgeprogrammeerde bewegingen zijn opgenomen in een bibliotheek, die uitbreidbaar is. De onderzoekers willen deze bibliotheek verrijken met meer bewegingen, zodat meer besturingsmogelijkheden beschikbaar worden. Ook willen de onderzoekers de database evalueren met meer gebruikers en meer robots.

Elektromyografie

Conduct-a-Bot maakt zoals eerder genoemd gebruik van spier- en bewegingssensoren om bewegingen van mensen te registreren. In het specifiek gaat het hierbij om elektromyografie (EMG) sensoren die op de biceps en triceps worden gedragen. Op de onderarm draagt de gebruiker een draadloos apparaat waarin EMG- en bewegingssensoren zijn verwerkt.

De informatie die met behulp van dit systeem wordt verzameld wordt geanalyseerd met behulp van machine learning technologie. De technologie scheidt hierbij in realtime acht mogelijk gebaren van andere bewegingen van de gebruiker. Dit maakt het mogelijk een robot in realtime aan te sturen met behulp van handgebaren.

Geen handmatige kalibratie

Het systeem kalibreert zichzelf om de signalen van verschillende gebruikers juist te interpreteren. Dit proces vindt plaats terwijl gebruikers de technologie gebruiken; kalibreren vooraf is dus niet nodig. Het systeem leert hierbij telkens van zijn vorige gebruiker.

In het huidige experiment is gebruik gemaakt van een combinatie van MyoWare sensoren met elektrodes van Medtronic Minimally Invasive Therapies (voorheen bekend als Covidien) en een USB-6216 van National Instruments om de gegevens uit te lezen. Het draadloze apparaat dat op de onderarm wordt gedragen is een Myo Gesture Control Armband. De onderzoekers wijzen erop dat in de toekomst mogelijk ook andere sensoren en input-/output-lezers gebruikt kunnen worden.

Paper

In de paper ‘Plug-and-Play Gesture Control Using Muscle and Motion Sensors‘ gaan de onderzoekers dieper in op hun technologie en bevindingen. In de onderstaande presentatie zetten zij hun systeem uiteen.

Auteur: Wouter Hoeffnagel

Meer nieuws

Robot van Deense O-Robotics ruimt straten op

(productnews)

Algemeen / 18-12-2024

Lees meerGrootste fractie Europarlement wil streep voor verbod op verbrandingsmotor

(productnews)

Automotive / 16-12-2024

Lees meerNieuw multifunctioneel zonneraam wekt stroom op door licht te weerkaatsen

(productnews)

Bouw & Constructie / 16-12-2024

Lees meerPBL: ‘Nederland op koers om streefdoel van 35 TWh aan wind- en zonneparken in 2030 te halen’